高性能应用服务(Hyper Application Inventor,HAI)是一款面向 AI 、科学计算的 GPU 应用服务产品,提供即插即用的澎湃算力与常见环境,助力中小企业及开发者快速部署 LLM。

大幅降低GPU云服务器使用门槛,多角度优化产品使用体验,开箱即用,如下图:

选择基础环境“Ubuntu 20.04”镜像,环境配置:Ubuntu 20.04, Driver 525.105.17, Python 3.8, CUDA 12.0, cuDNN 8,镜像已经帮我们安装好了驱动,选择按量付费,如下图:

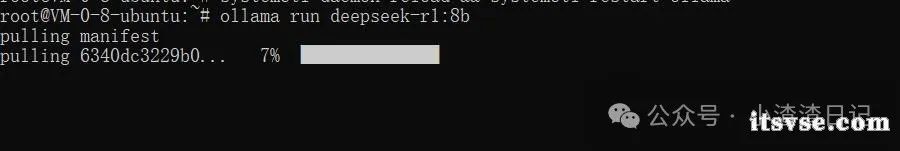

等待几分钟后,实例创建成功,同时,将学术加速打开,如下图: 第一次使用的时候,需要重置密码,登录用户名为:ubuntu。(略)尝试登陆到服务器,查看 NVIDIA GPU 驱动信息,命令如下:Ollama 官网:https://ollama.com/使用 putty 工具登录到服务器,开始安装 Ollama 工具,命令如下:curl -fsSL https://ollama.com/install.sh | sh>>> Installing ollama to /usr/local>>> Downloading Linux amd64 bundle######################################################################## 100.0%>>> Creating ollama user...>>> Adding ollama user to render group...>>> Adding ollama user to video group...>>> Adding current user to ollama group...>>> Creating ollama systemd service...>>> Enabling and starting ollama service...Created symlink /etc/systemd/system/default.target.wants/ollama.service → /etc/systemd/system/ollama.service.mkdir -p /data/ollama/modelschown -R ollama:ollama /data/ollama/models修改默认监听地址、模型存储路径(不能修改默认端口,否则执行命令会失败),命令如下:mkdir -p /etc/systemd/system/ollama.service.dvim /etc/systemd/system/ollama.service.d/override.confEnvironment="OLLAMA_HOST=0.0.0.0:11434"Environment="OLLAMA_MODELS=/data/ollama/models"systemctl daemon-reload && systemctl restart ollamasystemctl show ollama | grep Environment运行 deepseek-r1:8b 模型,命令如下:ollama run deepseek-r1:8b防火墙放行 TCP 11434 端口,调用 HTTP 接口,如下图: "name": "deepseek-r1:8b", "model": "deepseek-r1:8b", "digest": "28f8fd6cdc677661426adab9338ce3c013d7e69a5bea9e704b364171a5d61a10", "parameter_size": "8.0B", "quantization_level": "Q4_K_M" "expires_at": "2025-02-05T21:14:50.715753614+08:00",

ollama 命令

ollama list:显示模型列表

ollama show:显示模型的信息

ollama pull:拉取模型

ollama push:推送模型

ollama cp:拷贝一个模型

ollama rm:删除一个模型

ollama run:运行一个模型 |

推荐本站淘宝优惠价购买喜欢的宝贝:

本文链接:https://hqyman.cn/post/10007.html 非本站原创文章欢迎转载,原创文章需保留本站地址!

打赏

微信支付宝扫一扫,打赏作者吧~

休息一下~~

微信支付宝扫一扫,打赏作者吧~

微信支付宝扫一扫,打赏作者吧~